今天,谷歌云推出了两款面向 AI 的新产品,新一代Axion CPU以及Ironwood TPU,旨在用于大规模AI模型的训练和低延迟推理。

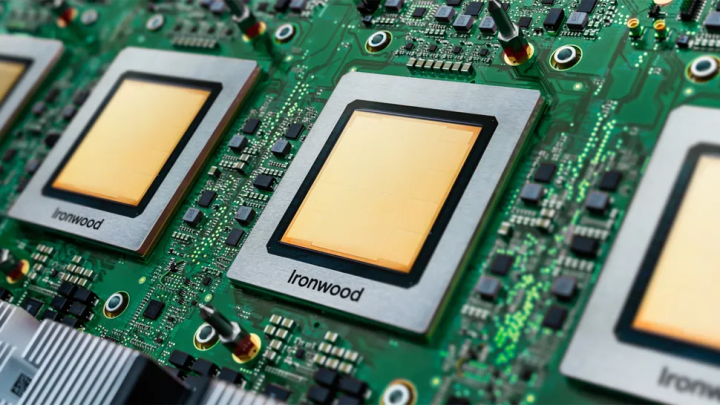

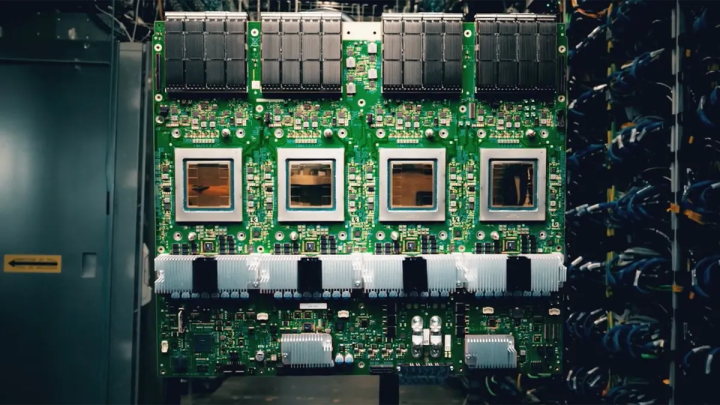

Ironwood是Google第7代张量处理单元(TPU),可提供 4,614 FP8 TFLOPS 的性能,配备 192 GB HBM3E 内存,带宽高达7.37 TB/s。Ironwood吊舱可扩展至 9,216 个AI加速器,为训练和推理提供总共42.5 FP8 ExaFLOPS,超过了Nvidia GB300 NVL72系统的0.36 FP8 ExaFLOPS。同时该吊舱使用专有的9.6 Tb/s芯片间互连网络来实现互联,总共携带约1.77 PB的HBM3E内存,再次超越了英伟达平台所能提供的内存容量。

基于Axion CPU和Ironwood TPU的Ironwood吊舱可以加入运行数十万个TPU的集群中,这些TPU构成了谷歌AI超级计算机的一部分。这是一个集成的超级计算平台,将计算、存储和网络统一在一个管理层下。为了提高超大型吊舱和 AI 超级计算机的可靠性,谷歌使用名为光路交换的可重构结构,它可以立即避免任何硬件中断以维持连续运行。

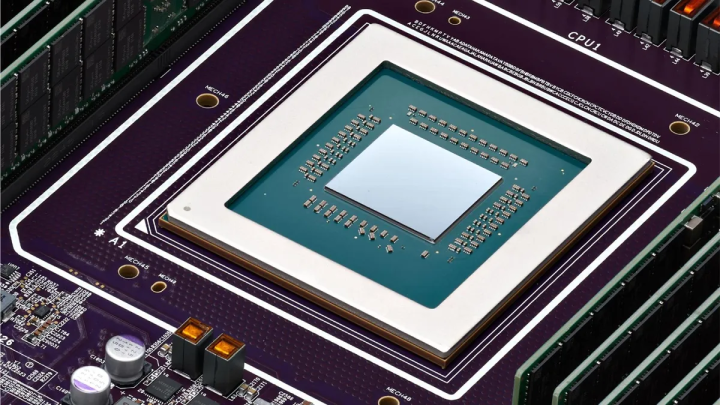

同时为了摆脱对英特尔、英伟达的依赖,谷歌、微软和亚马逊三大国际云平台巨头均有了Arm架构的数据中心CPU。谷歌早在去年就发布了其首款基于 Armv9 的通用处理器,名为 Axion。

至于这次全新的Axion CPU,目前谷歌尚未公布其完整的芯片规格没有确认每个芯片的核心数量,没有公开的频率,也没有公开该产品的制程节点。所能知道的只是,Axion是围绕Arm Neoverse v2平台构建的。但有报道称该 CPU 每个核心提供 2 MB 的私有 L2 缓存,80 MB 的 L3 缓存,支持 DDR5-5600 MT/s 内存,并且节点支持统一内存访问(UMA)。

这些新产品的开发建立在谷歌十年间定制芯片开发的基础上,从最初的TPU开始,一直延续到Tensor 移动处理器和 Titanium 基础设施。Axion CPU是谷歌首款基于Arm的通用服务器处理器,不仅完善了该公司的定制芯片产品组合,甚至Ironwood TPU还为与其他AI加速器的竞争奠定了基础。

(文中图片来源于网络)

桌面电脑>

CPU主板显卡>

桌面电脑>

CPU主板显卡>